Что в выпуске?

🌇 Привет, это твой новый ИИ-дайджест 2 февраля

Вот что я тебе сегодня приготовил и зачем тебе тратить 7 минут чтобы это прочитать

🦞 MoltBot - как хайп за неделю превратился в социальную сеть

🧬 Теперь расшифровывать мутации ДНК можно дома и без интернета

🎬 1776-й по календарю - AI-сериал, который провоцирует индустрию.

И ещё +9 новостей - быстрых, как ИИ: Apple купила Q AI почти за $2B, Kevin Weil из OpenAI пояснил правила IP-сделок для корпораций, Anthropic получил иск от музыкальных компаний за 20,000+ песен и $3B+ требований, Nvidia/Microsoft/Amazon обсуждают до $60B в раунде OpenAI, Anthropic якобы поднимает до $20B при оценке $350B, Google добавила Agentic Vision в Gemini 3 Flash, Mistral обновила Vibe до 2.0, Jared Kaplan из Anthropic дал прогноз про “замену” топ-теоретфизиков, Китай одобрил ByteDance/Alibaba/Tencent на 400k+ H200.

⚠️ ДИСКЛЕЙМЕР

ПРОЧТЕНИЕ ЭТОГО ДАЙДЖЕСТА РЕЗКО ПОВЫШАЕТ УРОВЕНЬ FOMO, ИДЕАЛЬНО ДОПОЛНЯЕТ УТРЕННИЙ КОФЕ И КАТЕГОРИЧЕСКИ ПРОТИВОПОКАЗАНО ПЕРЕД МЕДИТАЦИЕЙ И СНОМ — ВОЗМОЖНЫ ПРИСТУПЫ ВНЕЗАПНЫХ ИНСАЙТОВ И НЕУДЕРЖИМОЕ ЖЕЛАНИЕ СРОЧНО ЗАПИЛИТЬ СВОЙ СТАРТАП.

ПОГНАЛИ!

ИИ чудо

Nano Banana

Я придерживал историю про MoltBot потому что не мог поверить, что это именно оно. Я обожаю истории про мгновенный успех. Когда маркетологи приложений жгут сотни тысяч долларов на установки, проверяют гипотезы, и месяцами не попадают в аудиторию. Тут же случился идеальный шторм, когда успех прилетел за одну ночь. И цена у таких историй тоже прилетает быстро. Итак, погнали.

Сначала все выглядит как мечта продакта: open-source ассистент, который ты ставишь у себя, подключаешь модель (ChatGPT/Claude и т.д.), даешь доступ к почте, файлам, браузеру, мессенджерам - и дальше общаешься с ним как с человеком. Пишешь в чат, он делает цепочку действий и возвращается с “готово”. К 1-2 февраля большие медиа уже писали про 600k+ загрузок.

В чем фишка и чем это отличается от того что было раньше?

У OpenAI/Anthropic/Google “агент” обычно живет внутри их интерфейса и их подключений: ты запускаешь задачу в чате, агент делает шаги через встроенные инструменты, и ты по сути работаешь в их песочнице. Аналоги MoltBot в open-source мире есть - AutoGPT-класс автономных агентов и Open Interpreter-класс “модель с руками” на локальной машине. MoltBot оказался круче для массы людей из-за упаковки: он ставится как постоянный сервис на твоем железе, управляется привычным сообщением в мессенджере, держит контекст между сессиями и ведет себя как исполнитель “на смене” - ты написал и ушел, а он сам вернулся с результатом. Вирусность дала комбинация “ноль трения на входе” + “реальные бытовые цепочки действий” + open-source эффект, когда демки и конфиги копируются мгновенно, а вокруг названия сразу начинается шум, подделки и обсуждение рисков, которое только подогревает интерес.

Основные события недели:

26 января, понедельник

Проект, который лежал в репозитории с декабря, начинает массово разноситься по соцсетям через кейсы “поставил локально, пишу в мессенджер, бот делает действия”. Счетчик GitHub stars за день прибавляет +9 000 и доходит до 10 200.

27 января, вторник

Включается корпоративная реакция: юристы Anthropic просят сменить название, потому что Clawdbot и их Claude/маскот Clawd выглядят как близкие бренды. Проект переименовывают в Moltbot. На фоне шума счетчик GitHub stars прибавляет +50 600 и доходит до 60 800.

В тот же день приходит первая паразитная волна: Aikido Security ловит фейковое расширение VS Code “ClawdBot Agent”, внутри ScreenConnect RAT (удаленный доступ). Это важный триггер недели: бренд стал приманкой сразу после выхода в тренды.

28 января, среда

Проект уходит из “новинка дня” в “ставлю себе домой”: появляются гайды, сборки, повторяемые сценарии. Китайские тех-медиа фиксируют в цифре: репозиторий проходит уровень 70 000 stars. Прирост за день около +9 200, счетчик доходит до ~70 000.

29 января, четверг

Рынок переключается в режим “сначала безопасность”: выходят разборы рисков агентного софта с полным доступом, параллельно всплывают истории про подделки и трояны. По счетчику это рекордный день: +17 830 stars за сутки, всего 91 756.

Эта же дата закрепляет тему с подделками в широкой прессе: медиа пересказывают кейс с фейковым VS Code-ассистентом и вредоносом.

30 января, пятница

Команда фиксирует следующий ребренд: Moltbot переезжает в OpenClaw, параллельно появляется Moltbook как “соцсеть для агентов”. Это второй большой триггер недели: вокруг проекта появляется отдельная площадка и отдельный инфоповод, который распространяется быстрее, чем любые технические детали.

По GitHub stars еще один исторический прирост: +16 338 за сутки, всего 106 124.

31 января, суббота

Подключаются большие медиа и безопасники уже в режиме “это новая поверхность атаки”: обсуждают, что автономность + интеграции превращают такие инструменты в цель для злоумышленников. На счетчике GitHub stars проект проходит 114 000+ (плюс примерно +8k за сутки от уровня 106k).

1 февраля, воскресенье

Идет стадия “массовая установка и обмен конфигами”: люди делятся сетапами, отдельным железом под агента, правилами доступа. Суточный снимок из GitHub-рейтинга показывает 133 818 stars. Это плюс примерно +20k относительно “114k+” днем раньше.

2 февраля, понедельник

История перестает быть “репозиторий с ботом” и превращается в отдельную площадку: запускается Moltbook - Reddit-стайл лента, где постят и комментируют уже сами агенты, а люди смотрят как зрители. За считанные дни там заявляют 1.4M зарегистрированных агентов и 1M+ человеческих посетителей, при этом исследователь отдельно утверждает, что накрутил 500k аккаунтов одним ботом. Внутри начинается странное шоу: агенты придумывают “религию” Crustafarianism, стебут своих владельцев и обсуждают закрытые каналы “без людей”. На эту же дату прилетает жирная цитата от бывшего исследователя OpenAI Андрея Карпаты: он называет происходящее “самым невероятным sci-fi takeoff-adjacent”, которое видел недавно. И параллельно вылезает технический удар: 404 Media пишет, что база Moltbook была настроена так, что наружу торчали данные, включая API-ключи агентов, и это открывало дорогу к перехвату чужих аккаунтов. В тот же день фиксируют итог масштаба вокруг OpenClaw: в прессе проходит цифра 600k+ downloads, а GitHub-счетчик уже в районе 147k stars.

Реакция:

Ars Technica смотрит на MoltBot как на смену привычки: агент сидит у тебя локально, живет 24/7, ты дергаешь его через мессенджер, он сам возвращается с результатом. Их ключевая мысль - вся полезность держится на широких правах, поэтому риск встроен в архитектуру: чем больше “рук”, тем больше цена одной ошибки в доступах.

Business Insider дает разбор механики вирусности: создатель, “vibe coding”, поддержка заметных людей из тех-тусовки, мода держать агента на отдельной машинке, плюс сюжет с письмом от Anthropic про переименование. Их линия проста: проект стал культурным объектом, и скорость разгона обеспечили люди, которые любят копировать рабочие сетапы друг у друга.

404 Media делает самую полезную для понимания “цены скорости” вещь - показывает конкретную дыру Moltbook: база была настроена так, что наружу торчали данные и ключи агентов, и это открывало путь к захвату аккаунтов. Это реакция уровня “меньше философии, больше последствий”: платформа родилась на хайпе, инфраструктура отстала на пару дней, и этих дней хватило.

Vectra AI формулирует угрозу на языке безопасников: автономный агент с интеграциями становится “теневым суперпользователем” внутри системы. В их логике ценность агента равна набору прав, а атакующему нужен ровно этот набор: initial access, движение по системе, исполнение действий твоими руками. Это уже не разговор про “вредный промпт”, это разговор про новый класс доступа

И что?

Было предсказание, в том числе и мое, что новым миллиардером станет соло-фаундер, который сам не пишет код, а умеет вайбкодить и быстро собирать продукты из готовых деталей. MoltBot - первая неделя, где это перестало быть теорией. Один человек без команды выкатил штуку, которая за 7 дней получила две отдельные “революции”: сначала домашний агент, которого люди реально ставят себе и дают доступ к жизни, потом Moltbook - социальная сеть, где агенты уже постят и общаются как отдельная сущность. Это обсуждают исследователи уровня Андрея Карпаты, об этом пишут крупные издания, и рынок реагирует мгновенно: юристы, мошенники, безопасники, хостинг-провайдеры - все включились в тот же цикл. Тут может не родиться “тот самый миллиардер”, но прецедент уже есть: один соло-фаундер на вайбкоде способен за неделю создать продукт и побочный эффект масштаба, который начинает менять поведение людей и повестку индустрии. Сегодня кстати день вайбкодера.

Нам 3.14здец:

Старой модели “подняли раунд - наняли 8 инженеров - полгода пилим MVP” - 10/10 - почему: код теперь делается со скоростью мысли, и его можно накидать соло. Главная валюта - внимание и сюжет, который люди тащат друг другу бесплатно. MoltBot показал, что “соло-фаундер + вайбкод + понятный кейс” за неделю может собрать масштаб, который раньше требовал команды, бюджета и месяцев. Инвесторы после таких недель начинают смотреть косо на проекты без истории уровня “взлетело само”.

Что делать:

Делать продукт так, чтобы его можно было пересказать одной фразой

Строить дистрибуцию как часть продукта: комьюнити, репозиторий, шаблоны, демки, повторяемые кейсы.

Закрывать бренд в первый день: имя, хендлы, домены, чтобы паразиты не отжали повестку.

Держать “нескопируемое” рядом с кодом: данные, доступы к каналам, интеграции, партнерства, контракты.

Nano Banana

Представь, что у человечества есть гигантская книга инструкций на 3 миллиарда букв. Мы давно умеем читать заголовки: гены, белки, вся эта база из учебника. А вот смысл большинства страниц - темный лес. И каждый раз, когда в этой книге появляется опечатка, врачам и биологам приходится играть в детектива годами: где сломалось, почему сломалось, и при чем тут мутация, которая вообще сидит далеко от “пострадавшего” гена.

Google DeepMind прошлым летом показали штуку, которая обещает ускорить этот детектив: AlphaGenome берет до 1 миллиона букв ДНК за раз и предсказывает, как изменения в этом куске повлияют на работу регуляции. Тогда это выглядело как “круто, но посмотрим”. А на этой неделе они сделали ход, который превращает демо в инструмент: вышла статья в Nature и одновременно выложили исследовательский код и веса. То есть теперь это можно реально ставить в пайплайн лаборатории, а не обсуждать в твиттере.

Фактура:

Кто: Google DeepMind.

Что сделали: опубликовали полноценную статью про AlphaGenome в Nature и открыли доступ к инструментам, включая веса модели для исследований.

Что это за штука: AlphaGenome - “sequence-to-function” модель. На вход даешь 1 Mb ДНК (1,000,000 base pairs), на выходе получаешь предсказания тысяч “геномных треков” с точностью до одной буквы, сразу по нескольким типам биологии.

Какие процессы она покрывает: в статье перечислены модальности вроде экспрессии генов, старт транскрипции, доступность хроматина, гистонные модификации, связывание факторов транскрипции, 3D-контакты хроматина, сплайсинг. В целом они формулируют это как 11 типов выходов/активностей.

Чем хвастаются по качеству: в Nature пишут, что модель “совпадает или превосходит” лучшие внешние решения в 25 из 26 оценок по предсказанию эффекта вариантов.

Почему это важно именно для “98% ДНК”: большая часть генома - некодирующая, и там сидит море вариантов, которые влияют на регуляцию. DeepMind прямо продают AlphaGenome как инструмент для интерпретации этого пласта.

Где взять: код и клиент для API лежат на GitHub, веса доступны через Hugging Face и Kaggle (под условия).

И что?

AlphaFold уже показал, что “модель + массовый доступ” ускоряет науку и продуктовые линии. Тут ставка похожая, только поле грязнее: регуляция генов, дальние связи по ДНК, тканеспецифичность. Но эффект может быть такой же: больше гипотез за меньше времени, дешевле приоритизация мутаций для диагностики, быстрее старт экспериментов и дизайн терапий. И это прямо про конкуренцию стран и фармы: у кого лучше интерпретация генома, у того быстрее цикл от данных до лекарства.

🚨Нам 3.14здец:

Генетическим тестам “для людей” и биомед-стартапам без сильной вычислительной и ML-команды - 8/10 - почему: теперь у исследователей будет стандарт “прогнал через AlphaGenome”, и все, кто продает интерпретацию вариантов как магию, окажутся под давлением по скорости и качеству.

Что делать:

Встраивать AlphaGenome в пайплайн как baseline и сравнивать свои модели с ним на публичных бенчмарках.

Сразу разделять “исследовательская гипотеза” и “клиническое решение”: модель дает подсказки, подтверждение остается экспериментом.

Если ты стартап в геномике - упаковывать ценность вокруг данных, когорты, клинических связок и workflow, а не вокруг “у нас есть модель, которая понимает ДНК”.

AI go Hollywood

Nano Banana

Люди давно хотели изобрести машину времени. Обычно - чтобы подсмотреть будущее. Но иногда хочется проще: посмотреть прошлое так, будто ты там стоишь рядом. Какими мы были 250 лет назад - своими глазами, а не через музейные полотна и привычный костюмный продакшн.

Так вот. В прошлое ты не попадешь. Зато теперь можешь каждый день открывать смартфон и получать короткий “репортаж” из 1776-го - ровно в день 250-летия события. Это и есть серия “On This Day… 1776”, которую запустила AI-студия Primordial Soup Аронофски.

И вот тут самое важное: визуал там делает Google DeepMind, а голоса - живые, от SAG-AFTRA. Они специально выстроили конструкцию “режиссер рулит, AI крутит станок”, чтобы история не выглядела как автоматическая нарезка. Вышло громко. И конфликтно.

Фактура:

Что сделали: короткий сериал “On This Day… 1776” про Американскую революцию, эпизоды выходят по календарю - в день 250-летия каждого показанного события.

Где выходит: на YouTube-канале TIME, то есть это сразу большой дистрибуционный кран, а не “залили в твиттер для друзей”.

Чем делают картинку: инструменты Google DeepMind для генерации видео, история тянется из их коллаборации с Аронофски, которую объявляли еще в 2025, и из публичных показов вроде ANCESTRA на Tribeca Film Festival.

Почему они упирают в “artist-led”: потому что тема токсичная для индустрии, и участие профсоюзной озвучки становится маркером “мы пытаемся играть по правилам”.

И что?

AI-видео перестает быть трюком “сгенерили один ролик”. Тут важнее другое: регулярный выпуск контента по расписанию, с продюсерской упаковкой, партнером масштаба TIME, и с легализацией через актерские голоса. Для рынка это означает простую вещь - студии начинают покупать не “AI-картинку”, а “AI-пайплайн”, который позволяет выпускать сериально и дешево. А дальше это пролезет в рекламу, документалки, образовательный контент, и везде, где решает скорость выпуска.

Нам 3.14здец:

Небольшим продакшн-студиям и всему бизнесу “быстро делаем видео под дату” - 8/10 - почему: теперь крупные игроки могут штамповать серии под календарь, подкладывать живые голоса и продавать это как нормальный медиа-продукт.

Что делать:

Упаковать услугу в “выпуск под ключ” - сценарий, фактчек, монтаж, озвучка, права, публикация, а не просто “сгенерим визуал”.

Ввести контроль качества лиц, движения, исторических деталей - именно туда бьет критика и именно это отличает ремесло от автогенерации.

Сразу держать юридику и источники данных в порядке - любой проект с AI-видео будут копать по происхождению материалов и по правам.

БЫСТРЫЕ КАК ИИ НОВОСТИ

Что еще случилось с момента выхода крайнего выпуска

💸 OpenAI (разработчик ChatGPT) ведет переговоры, чтобы Nvidia, Microsoft и Amazon занесли до $60B в раунде (по данным Reuters, со ссылкой на The Information). И что? Это закрепляет модель “у кого деньги и GPU - у того и темп прогресса”, и повышает порог входа для конкурентов в большие модели.

🇨🇳 Китай условно одобрил ByteDance, Alibaba и Tencent (плюс DeepSeek) на покупку суммарно 400k+ NvidiaH200. И что? Узкое горлышко по топовым чипам в Китае ослабляется, и конкуренция “модели + цена” в 2026 станет жестче, потому что у крупных китайских игроков будет больше вычислений.

🎧 Apple купила Q.ai (израильский стартап по аудио-AI и “silent speech”) примерно за $1.6B, команда около 100 человек, CEO - Aviad Maizels (делал PrimeSense, чьи техи потом стали частью Face ID). И что? Apple усиливает ставку на интерфейс “голос/шепот/беззвучная речь” в носимых устройствах и системных ассистентах - это влияет на рынок voice-tech и на то, как будет выглядеть “Siri следующего поколения”.

🏦 Anthropic (делает Claude) поднимает план раунда до $20B при оценке $350B, спрос у инвесторов в 5-6 раз выше ожиданий (FT). И что? Деньги окончательно переезжают из “венчур ради роста” в “венчур ради инфраструктуры”, и рынок начинает жить логикой нескольких супер-лабораторий с ценниками уровня мегакорпов.

🎵 Universal Music Group, Concord и ABKCO снова судятся с Anthropic: заявляют про 20,000+ песен и потенциальные damages больше $3B. И что? Для всего AI-аудио это усиливает “лицензионный налог”: чем ближе ты к музыке и голосу, тем выше шанс, что тебе прилетит не за продукт, а за датасет и права.

🖼️ Google добавил Agentic Vision в Gemini 3 Flash: модель сама зумит/помечает/проверяет картинку пошагово, и это дает +5-10% качества на vision-бенчмарках (по их заявлению). И что? Это влияет на все задачи “картинка как документ”: схемы, скриншоты, фото с производства - модели становятся полезнее там, где раньше галлюцинировали на мелких деталях.

🧑💻 Mistral AI (французская AI-компания) обновила терминальный агент Vibe до 2.0: кастомные сабагенты, навыки, на планах Le Chat Pro/Team (в районе $15/мес за Pro). И что? Это подталкивает рынок “агент в терминале” как стандартную форму работы разработчика: не чат рядом, а исполнитель прямо в CLI с навыками и сценариями.

🧾 Kevin Weil (CPO в OpenAI) отдельно пояснил: их “IP-based / outcome-based” договоренности про разделение ценности - только для крупных организаций по кастомным контрактам, а не про “заберем долю у одиночек за идею”. И что? Это влияет на восприятие OpenAI как поставщика для enterprise: меньше паники про “компания претендует на результаты пользователей”, больше фокуса на крупных, переговорных сделках.

🧠 Jared Kaplan (сооснователь Anthropic, бывший физик) сказал: “50% шанс”, что в 2-3 года топовых теоретфизиков “в основном заменит” AI. И что? Это влияет не на физику, а на статус “элитной аналитики”: публичная планка ожиданий от AI в науке и R&D снова поднимается, и потом рынок начинает требовать результаты быстрее.

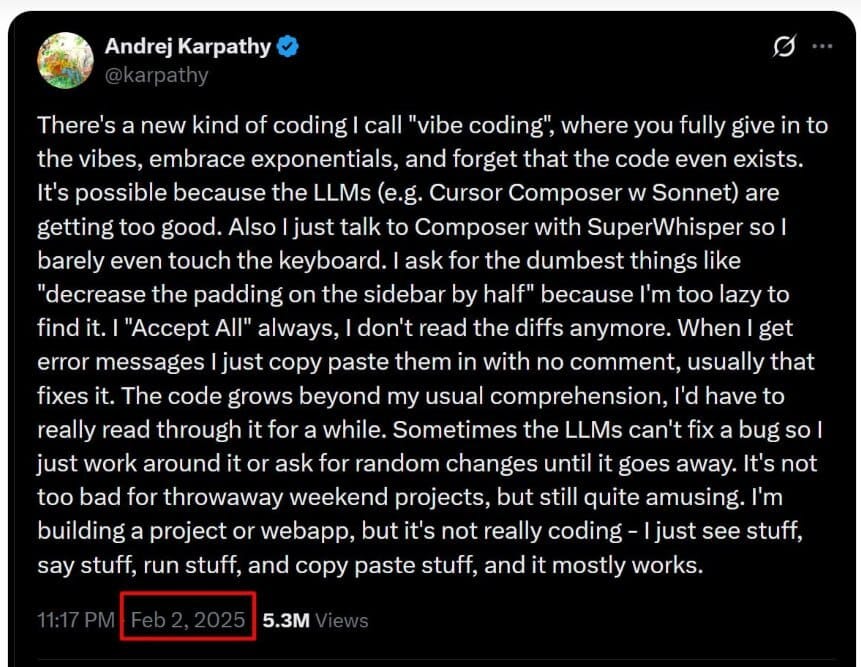

🗓️ 2 февраля - неофициальный “день вайбкодера”: год назад Andrej Karpathy описал vibe coding и собрал 5.3M просмотров. И что? Это закрепило норму “код как побочный продукт разговора”, и теперь соло-фаундеры реально могут собирать продукты без классической инженерной команды.

Перевод: «Есть новый вид программирования, который я называю “vibe coding” - когда ты полностью отдаешься вайбу, принимаешь экспоненты и забываешь, что код вообще существует.

Это стало возможным потому, что LLM (например, Cursor Composer с Sonnet) стали слишком хороши. Я еще и просто разговариваю с Composer через SuperWhisper, так что почти не трогаю клавиатуру. Я прошу максимально тупые вещи вроде “уменьши отступы у сайдбара вдвое”, потому что мне лень искать, где это. Я всегда жму “Accept All”, я больше не читаю диффы. Когда получаю сообщения об ошибках, я просто копипащу их без комментариев - обычно это решает проблему. Код разрастается за пределы моего обычного понимания, мне пришлось бы реально читать его какое-то время, чтобы разобраться. Иногда LLM не может починить баг, и я просто обхожу его или прошу про случайные изменения, пока он не исчезнет. Для одноразовых проектов на выходные это вполне окей и довольно забавно. Я делаю проект или веб-приложение, но это не совсем программирование - я просто вижу штуки, говорю штуки, запускаю штуки и копипащу штуки, и в целом оно работает.»

🚨 Нам 3.14здец: независимым AI-командам без денег - 9/10 - почему: капитал, вычисления и права на контент концентрируются у нескольких игроков, и правила игры становятся “дорого и юридически нервно”.

BIPIAI Встречи

📆 3 февраля в 18:00 (CET)

Практическая встреча, где спикер показывает, как собирать полноценную маркетинговую стратегию с помощью ИИ: структура, технология, готовые промпты и демонстрация результата на реальном примере. Без воды и “вдохновляющих разговоров”, только метод, который можно повторить.

—-

📝 Алгоритмическая торговля с ИИ без “хардкорного” кода: no-code / low-code лаборатория ботов (live demo)

📆 4 февраля в 18:00 (CET)

Практическая встреча о том, как собирать и тестировать торговых ботов за недели, а не месяцы: ИИ как “архитектор” и логический слой, no-code / low-code (vibe-coding) инструменты, быстрый цикл гипотез и связка с реальным брокером и рынком. Без “чёрных ящиков” и без ухода в программирование.

—-

📆 5 февраля в 18:00 (CET)

Закрытая практическая встреча про применение ИИ в 2026 году вне разработки приложений: энергетика, био-направления, агро/еда и другие индустрии. Разбираем реальные сценарии, что работает уже сейчас, и уходим с набором идей для пилотов и проектов.

BIPIAI Инструменты

📽️Sora 2 - Генерирует реалистичные и управляемые ролики по промпту, поддерживает сложные сцены и синхронизацию звука/диалогов через приложение Sora.

🧑🏿💻Replit - Онлайн IDE и платформа деплоя: генерируешь код, правишь, запускаешь и шаришь проект в одном месте, с помощниками для разработки.

🧠Notion AI - Помогает быстро находить информацию в рабочих пространствах, писать черновики, делать саммари страниц и улучшать тексты прямо в Notion.

BIPI AI - СООБЩЕСТВО!

Хочешь быстрее внедрять ИИ и меньше ошибаться - нужно окружение, где это делают каждый день.

BIPIAI - закрытый клуб фаундеров и топ-спецов.

Что внутри:

• разборы реальных бизнес-кейсов

• готовые пайплайны и шаблоны внедрения

• созвоны, где участники показывают, как у них устроено

• люди, которые помогают собрать решение под новую реальность

90+ участников, 15 стран.

На сегодня это все

Это был очень насыщенные и интересные 24 часа из мира AI и роботов, которые меняют нашу с вами жизнь.

До завтра!

Дмитрий Грин

P.S.

Чтобы помочь мне понять как вам этот дайджест. Пожалуйста нажмите на максимально релевантную кнопку.